研究了从云到网络边缘的高性能处理是如何使物联网(物联网)蓬勃发展,从而为人工智能奠定了基础。博客文章中还有一个需要我们充分关注的方面:人工智能的进步与网络威胁的发展密切相关。

每秒钟就会发现五种新的恶意软件变体。世界各地的组织每小时都会受到一百次以前未知的恶意软件攻击。每天都会有100万个新的恶意文件出现在连接的世界中。随着越来越多的设备和系统连接到网络上,网络犯罪已经对我们的技术资产--乃至整个社会的安全构成越来越大的威胁。

机器学习被证明是一把双刃剑:虽然ML能够使工业级恶意软件检测程序更有效地工作,但它很快就会被坏角色用来增强攻击的进攻能力。事实上,一群来自阿姆斯特丹大学最近演示了这是如何工作的。在从cpu翻译旁路缓冲器(TLB)泄露信息的侧通道攻击中,白帽黑客使用新颖的机器学习技术来训练他们的攻击算法,并将其提升到一个新的性能水平。他们相信机器学习技术将提高未来侧通道攻击的质量。

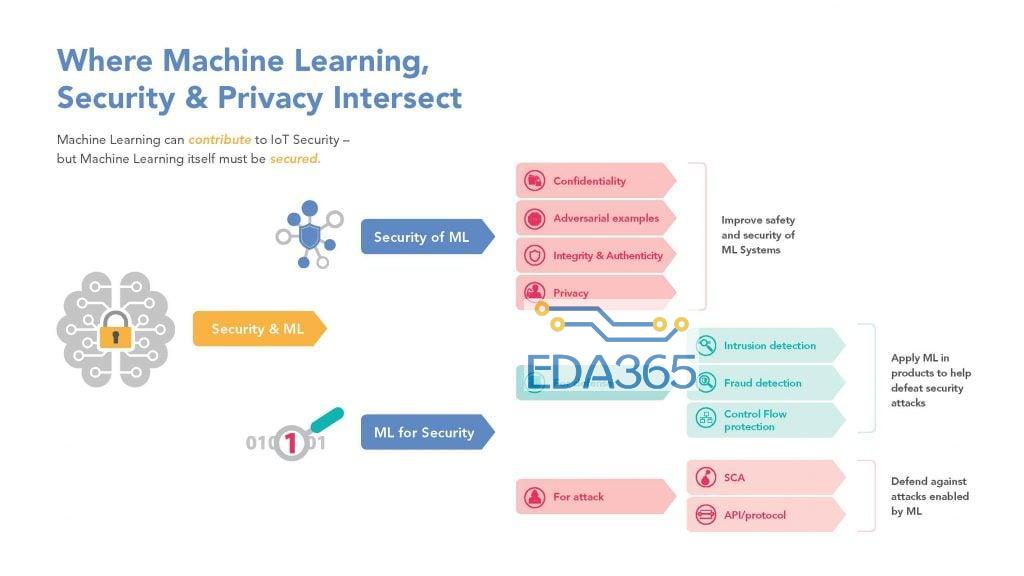

为了防止新的、有效的人工智能和ML技术的出现改变权力的平衡,我们必须把重点放在如何利用人工智能来提高系统的安全性和数据隐私。

ML如何增加系统安全性

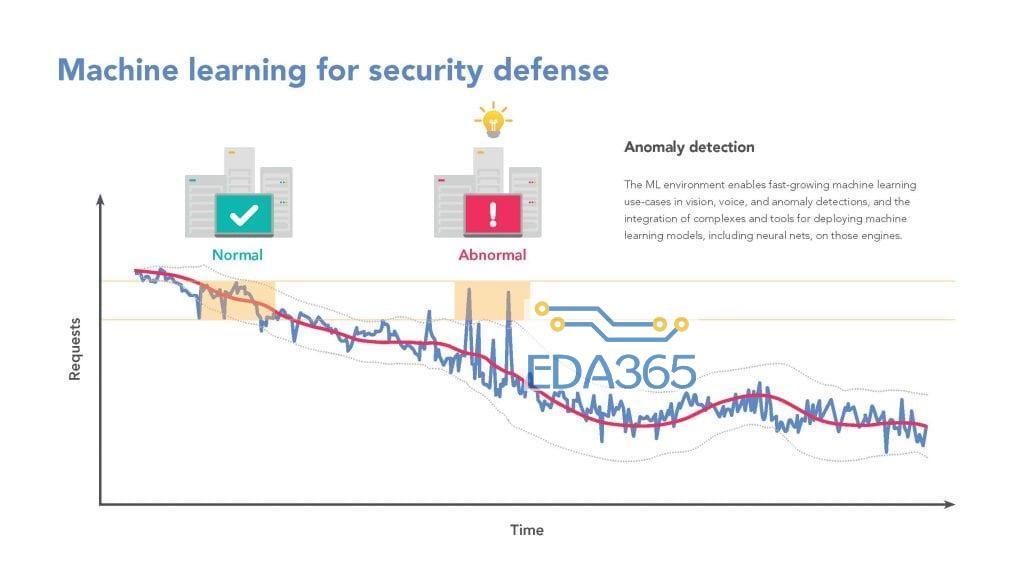

基于ML的安全的一个很好的例子是异常检测,其中系统“检测”数据流中的异常行为或模式。这个过程在过去经常被应用于垃圾邮件和恶意软件的检测,但是机器学习可以被扩展到寻找系统中更微妙和复杂的异常行为。虽然监测和保护免受外部威胁对于有效的系统防御至关重要,但很少有组织意识到内部威胁。在一项调查中2016年埃森哲他们发现,三分之二的接受调查的组织成为从组织内部窃取数据的受害者。在这些情况下,91%的人报告说,他们没有有效的检测方法来识别这类威胁。机器学习可以极大地帮助开发有效的、实时的分析和异常检测能力,以检测和消除来自系统内部的基于用户的威胁。

隐私保护机器学习

在人工智能的数据提供者(无论是在培训阶段还是在推理阶段)不想提供不受保护的数据的应用程序是很容易识别的。随着新的欧盟通用数据保护条例(GDPR)自2018年5月25日起生效,任何处理欧盟公民数据的企业都必须保护隐私,而不遵守规定可能导致巨额罚款。

在工业环境中,也有一些应用程序,在这些环境中,数据隐私对系统提供者至关重要。例如,在预测维护机器中,数据被用来确定在役设备的状态,以精确地预测应该在什么时候进行维护。此方法实现节省大量费用超过常规或基于时间的预防性维护,因为任务只在需要时执行,并且希望在系统故障之前执行。参与服务的机器所有者显然有意从生成的数据中获益,但是,他们也对不与使用同一台机器的竞争对手共享其数据非常感兴趣。这使维护服务提供商陷入困境。关键问题是:企业如何能够继续尊重隐私问题,同时仍然允许使用大数据来提升企业价值?

使用同态加密,计算中使用的任何数据都保持加密形式,并且只对预期用户可见。计算结果--一旦解密--与应用于明文的相同计算结果相匹配。此外,NXP使用的基于属性的身份验证基于IBM Research开发的身份混合器协议。它依赖于灵活的公钥(化名)和灵活的凭证的组合,允许用户只共享某个事务所需的信息,而不显示任何其他属性。

好处是显而易见的:“互联网就像月球表面,它永远不会忘记一个脚印。有了身份混合器,我们就可以把它变成一个沙滩,经常冲走一切。“简.卡尼梅西、密码学家和身份混合器的共同发明者。

攻击机器学习:训练时的攻击

即使在ML的第一阶段,当训练数据被收集并输入到ML模型时,也会发生攻击。为了防止改变数据或操纵ML模型的结果,一个典型的应用程序是一个从用户发送的数据中训练出来的异常检测工具。如果用户故意发送不正确的输入来“毒害”训练数据,这可能导致机器学习模型在推理时性能差甚至失败。

推理时的攻击:对抗性的例子

在推理阶段还必须保证用户的隐私。当对私有或敏感数据进行推断时,这一点尤其重要。用户也可以是攻击者。作为攻击手段,用户可以使用所谓的对抗性示例。对抗性示例是一个有效的输入数据,它将导致机器学习模型对其进行错误解释。这种看似良性的攻击可能造成灾难性的后果,例如,如果我们想到在安全危急情况下的道路标志分类。

在停车标志上贴上特制的贴纸,研究人员已经证明他们可以欺骗图像分类器误解或根本不识别符号。虽然这个标志在人眼看来是有规律的停车标志,但是机器学习模型却无法看到它本身。对抗性例子的概念并不新鲜。新发现的是其后果的严重性,比如在停车标志对抗性的例子中撞毁了一辆自动驾驶汽车。

ml作为服务:IP保护

机器学习模型的价值主要存在于相关的数据集中。培训数据的收集成本可能很高,或者很难获得。当机器学习作为一种服务提供时,用户只能访问模型的输入和输出。例如,对于图像分类器,用户提交图像并返回其类别。对于用户来说,为了避免为将来的使用付费,制作模型本身的副本可能很有诱惑力。一种可能的攻击是对所选择的输入数据进行查询,获取相应的输出,并对所获得的数据集进行训练,以获得一个功能等价的模型。

为什么现在是时候检查你的防御机制了?

在NXP,我们建造了一些世界上最先进的安全设备。我们在它们内部创建对抗措施,以保护它们免受广泛的逻辑和物理攻击,例如侧通道或模板攻击。黑客依靠人工智能从安全系统中提取机密和关键信息只是时间问题,因为这只会增强他们的“学习”能力。

为了应对这些不断变化的威胁,人工智能的影响必须成为物联网系统安全的组成部分。如果人工智能机器学习模型的训练和推理不能成为未来对手的大门,则必须从一开始就考虑设计的安全性和设计原则的隐私性。幸运的是,人工智能领域应用从物联网安全学到的经验还不算太晚。如果我们在设计未来的基础设施和设备时牢记这一点,那么AIoT就有能力改变我们的生活。把未来的黑匣子变成光明的盒子是我们的责任。

APP下载

APP下载 登录

登录

热门文章

热门文章