过去几十年,全球半导体行业增长主要受台式机、笔记本电脑和无线通信产品等尖端电子设备的需求,以及基于云计算兴起的推动。这些增长将继续为高性能计算市场领域开发新应用程序。

首先,5G将让数据量呈指数级增长。我们需要越来越多的服务器来处理和存储这些数据。2020年Yole报告,这些服务器核心的高端CPU和GPU的复合年增长率有望达到29%。它们将支持大量的数据中心应用,比如超级计算和高性能计算服务。在云游戏和人工智能等新兴应用的推动下,GPU预计将实现更快增长。例如,2020年3月,互联网流量增长了近50%,法兰克福的商业互联网数据交换创下了数据吞吐量超过每秒9.1兆兆位的新世界纪录。

第二个主要驱动因素是移动SoC——智能手机芯片。这个细分市场增长虽然没有那么快,但这些SoC在尺寸受限的芯片领域对更多功能的需求,将推动进一步技术创新。

除了逻辑、内存和3D互联的传统维度扩展之外,这些新兴应用程序将需要利用跨领域的创新。这需要在器件、块和SoC级别进行新模块、新材料和架构的改变,以实现在系统级别的效益。我们将这些创新归纳为半导体技术的五大发展趋势。

趋势一:摩尔定律还有用,将为半导体技术续命8到10年…

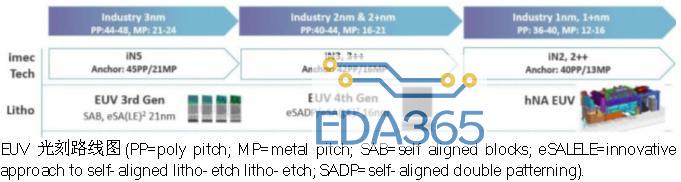

在接下来的8到10年里,CMOS晶体管的密度缩放将大致遵循摩尔定律。这将主要通过EUV模式和引入新器件架构来实现逻辑标准单元缩放。

在7nm技术节点上引入了极紫外(EUV)光刻,可在单个曝光步骤中对一些最关键的芯片结构进行了设计。在5nm技术节点之外(即关键线后端(BEOL)金属节距低于28-30nm时),多模式EUV光刻将不可避免地增加了晶圆成本。最终,我们希望高数值孔径(High-NA) EUV光刻技术能够用于行业1nm节点的最关键层上。这种技术将推动这些层中的一些多图案化回到单图案化,从而提供成本、产量和周期时间的优势。

Imec对随机缺陷的研究对EUV光刻技术的发展具有重要意义。随机打印故障是指随机的、非重复的、孤立的缺陷,如微桥、局部断线、触点丢失或合并。改善随机缺陷可使用低剂量照射,从而提高吞吐量和成本。

为了加速高NAEUV的引入,我们正在安装Attolab,它可以在高NAEUV工具面世之前测试一些关键的高NAEUV材料(如掩膜吸收层和电阻)。目前Attolab已经成功地完成了第一阶段安装,预计在未来几个月将出现高NAEUV曝光。

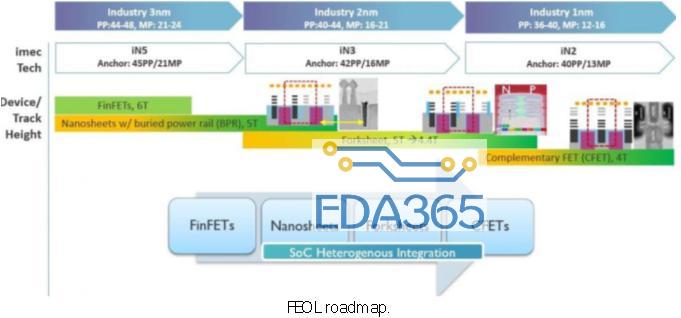

除了EUV光刻技术的进步之外,如果没有前沿线端(FEOL)设备架构的创新,摩尔定律就无法延续。如今,FinFET是主流晶体管架构,最先进的节点在6T标准单元中有2个鳍。然而,将鳍片长度缩小到5T标准单元会导致鳍片数量减少,标准单元中每个设备只有一个鳍片,导致设备的单位面积性能急剧下降。这里,垂直堆叠纳米薄片晶体管被认为是下一代设备,可以更有效地利用设备占用空间。另一个关键的除垢助推器是埋地动力轨(BPR)。埋在芯片的FEOL而不是BEOL,这些BPR将释放互连资源路由。

将纳米片缩放到2nm一代将受到n-to-p空间约束的限制。Imec设想将Forksheet作为下一代设备。通过用电介质墙定义n- p空间,轨道高度可以进一步缩放。与传统的HVH设计相反,另一个有助于提高路由效率的标准单元架构发展是针对金属线路的垂直-水平-垂直(VHV)设计。最终通过互补场效应晶体管(CFET)将标准cell缩小到4T,之后充分利用cell层面上的第三维度,互补场效应晶体管通过将n-场效应晶体管与p-场效应晶体管折叠。

趋势2:在固定功率下,逻辑性能的提高会慢下来

有了上述的创新,我们期望晶体管密度能遵循摩尔所规划的路径。但是在固定电源下,节点到节点的性能改进——被称Dennard缩放比例定律,Dennard缩放比例定律(Dennard scaling)表明,随着晶体管变得越来越小,它们的功率密度保持不变,因此功率的使用与面积成比例;电压和电流的规模与长度成比例。

世界各地的研究人员都在寻找方法来弥补这种减速,并进一步提高芯片性能。上述埋地电力轨道预计将提供一个性能提高在系统水平由于改进的电力分配。此外,imec还着眼于在纳米片和叉片装置中加入应力,以及提高中线的接触电阻(MOL)。

二维材料如二硫化钨(WS2)在通道中有望提高性能,因为它们比Si或SiGe具有更强的栅长伸缩能力。其中基于2d的设备架构包括多个堆叠的薄片非常有前景,每个薄片被一个栅极堆叠包围并从侧面接触。模拟表明,这些器件在1nm节点或更大节点上比纳米片的性能更好。为了进一步改善这些器件的驱动电流,我们着重改善通道生长质量,在这些新材料中加入掺杂剂和提高接触电阻。我们试图通过将物理特性(如生长质量)与电气特性相关联来加快这些设备的学习周期。

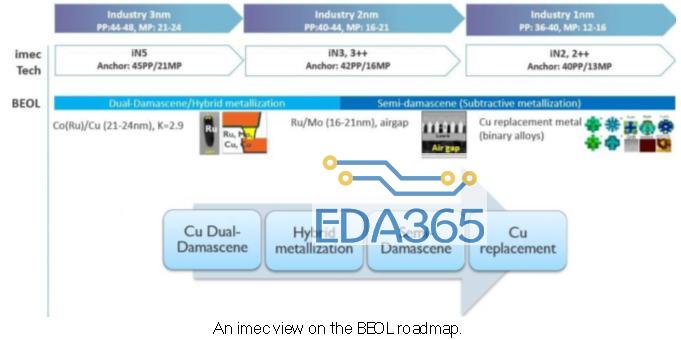

除了FEOL,走线拥挤和BEOLRC延迟,这些已经成为性能改善的重要瓶颈。为了提高通径电阻,我们正在研究使用Ru或Mo的混合金属化。我们预计半镶嵌(semi-damascene)金属化模块可同时改善紧密距金属层的电阻和电容。半镶嵌(semi-damascene)可通过直接模式和使用气隙作为介电在线路之间(控制电容增加)

允许我们增加宽高比的金属线(以降低电阻)。同时,我们筛选了各种替代导体,如二元合金,它作为‘good old’ Cu的替代品,以进一步降低线路电阻。

趋势3:3D技术使更多的异构集成成为可能

在工业领域,通过利用2.5D或3D连接的异构集成来构建系统。这些有助于解决内存问题,可在受形状因素限制的系统中添加功能,或提高大型芯片系统的产量。随着逻辑PPAC(性能-区域-成本)的放缓,SoC 的智能功能分区可以提供另一个缩放旋钮。一个典型的例子是高带宽内存栈(HBM),它由堆叠的DRAM芯片组成,这些芯片通过短的interposer链路直接连接到处理器芯片,例如GPU或CPU。最典型的案例是Intel Lakefield CPU上的模对模堆叠,AMD7nmEpycCPU。在未来,我们希望看到更多这样的异构SOC,它是提高芯片性能的最佳桥梁。

在imec,我们通过利用我们在不同领域(如逻辑、内存、3D…)所进行的创新,在SoC级别带来了一些好处。为了将技术与系统级别性能联系起来,我们建立了一个名为S-EAT的框架(用于实现高级技术的系统基准测试)。这个框架可评估特定技术对系统级性能的影响。例如:我们能从缓存层次结构较低级别的片上内存的3D分区中获益吗?如果SRAM被磁存储器(MRAM)取代,在系统级会发生什么?

为了能够在缓存层次结构的这些更深层次上进行分区,我们需要一种高密度的晶片到晶片的堆叠技术。我们已经开发了700nm间距的晶圆-晶圆混合键合,相信在不久的将来,键合技术的进步将使500nm间距的键合成为可能。

通过3D集成技术实现异质集成。我们已经开发了一种基于sn的微突起互连方法,互连间距降低到7µm。这种高密度连接充分利用了透硅通孔技术的潜力,使>16x更高的三维互联密度在模具之间或模具与硅插接器之间成为可能。这样就大大降低了对HBMI/O接口的SoC区域需求(从6 mm2降至1 mm2),并可能将HBM内存栈的互连长度缩短至多1 mm。使用混合铜键合也可以将模具直接与硅结合。我们正在开发3µm间距的模具到晶圆的混合键合,它具有高公差和放置精度。

由于SoC变得越来越异质化,一个芯片上的不同功能(逻辑、内存、I/O接口、模拟…)不需要来自单一的CMOS技术。对不同的子系统采用不同的工艺技术来优化设计成本和产量可能更有利。这种演变也可以满足更多芯片的多样化和定制化需求。

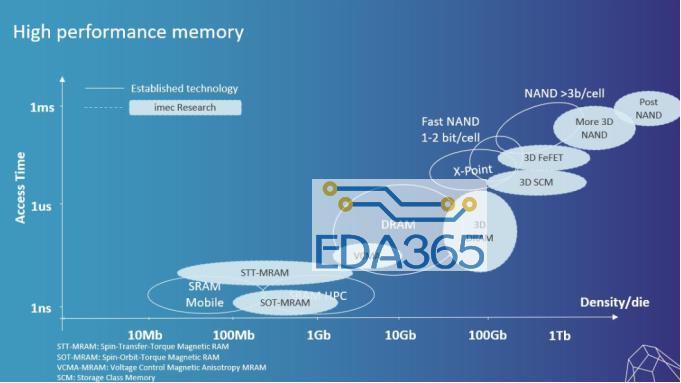

趋势4:NAND和DRAM被推到极限;非易失性存储器正在兴起

内存芯片市场预测显示,2020年内存将与2019年持平——这一变化可能部分与COVID-19减缓有关。2021年后,这个市场有望再次开始增长。新兴非易失性存储器市场预计将以>50%的复合年增长率增长,主要受嵌入式磁随机存取存储器(MRAM)和独立相变存储器(PCM)的需求推动。

NAND存储将继续递增,在未来几年内可能不会出现颠覆性架构变化。当今最先进的NAND产品具有128层存储能力。由于晶片之间的结合,可能会产生更多的层,从而使3D扩展继续下去。Imec通过开发像钌这样的低电阻字线金属,研究备用存储介质堆,提高通道电流,并确定控制压力的方法来实现这一路线图。我们还专注于用更先进的FinFET器件取代NAND外围的平面逻辑晶体管。我们正在探索3DFeFET与新型纤锌矿材料,作为3D NAND替代高端存储应用。作为传统3D NAND的替代品,我们正在评估新型存储器的可行性。

对于DRAM,单元缩放速度减慢,EUV光刻可能需要改进图案。三星最近宣布EUV DRAM产品将用于10nm (1a)级。除了探索EUV光刻用于关键DRAM结构的模式,imec还为真正的3D DRAM解决方案提供了构建模块。

在嵌入式内存领域,我通过大量的努力来理解并最终拆除所谓的内存墙,CPU从DRAM或基于SRAM的缓存中访问数据的速度有多快?如何确保多个CPU核心访问共享缓存时的缓存一致性?限制速度的瓶颈是什么?我们正在研究各种各样的磁随机存取存储器(MRAM),包括自旋转移转矩(STT)-MRAM,自旋轨道转矩(SOT)-MRAM和电压控制磁各向异性(VCMA)-MRAM),以潜在地取代一些传统的基于SRAM的L1、L2和L3缓存(图4)。每一种MRAM存储器都有其自身的优点和挑战,并可能通过提高速度、功耗和/或内存密度来帮助我们克服内存瓶颈。为了进一步提高密度,我们还在积极研究可与磁隧道结相结合的选择器,这些是MRAM的核心。

趋势5:边缘人工智能芯片行业崛起

边缘AI预计在未来五年内将实现100%的增长。与基于云的人工智能不同,推理功能是嵌入在位于网络边缘的物联网端点(如手机和智能扬声器)上的。物联网设备与一个相对靠近边缘服务器进行无线通信。该服务器决定将哪些数据发送到云服务器(通常是时间敏感性较低的任务所需的数据,如重新培训),以及在边缘服务器上处理哪些数据。

与基于云的AI(数据需要从端点到云服务器来回移动)相比,边缘AI更容易解决隐私问题。它还提供了响应速度和减少云服务器工作负载的优点。想象一下,一辆需要基于人工智能做出决定的自动汽车。由于需要非常迅速地做出决策,系统不能等待数据传输到服务器并返回。考虑到通常由电池供电的物联网设备施加的功率限制,这些物联网设备中的推理引擎也需要非常节能。

今天,商业上可用的边缘AI芯片,加上快速GPU或ASIC,可达到1-100Tops/W运算效率。对于物联网的实现,将需要更高的效率。Imec的目标是证明推理效率在10.000个Tops/W。

通过研究模拟内存计算架构,我们正在开发一种不同的方法。这种方法打破了传统的冯·诺伊曼计算模式,基于从内存发送数据到CPU(或GPU)进行计算。使用模拟内存计算,节省了来回移动数据的大量能量。2019年,我们演示了基于SRAM的模拟内存计算单元(内置22nm FD-SOI技术),实现了1000Tops/W的效率。为了进一步提高到10.000Tops/W,我们正在研究非易失性存储器,如SOT-MRAM,FeFET和基于IGZO(铟镓锌氧化物)的存储器。

『本文转载自网络,版权归原作者所有,如有侵权请联系删除』

热门文章

更多

热门文章

更多