本文针对传统自组织神经网络分类精度低和收敛速度慢的缺点进行改进。

2 自组织特征映射神经网络

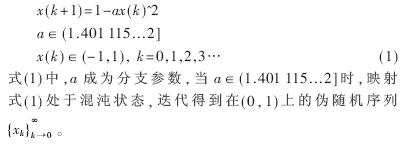

SOM网络能将任意维输入映射成一维或者二维离散图形,并保持其拓扑结构不变,此外,网络通过对输入模式的反复学习,可以使连接权值空间分布密度与输入模式的概率分布趋于一致。网络在竞争过程中,近邻者相互激励,远邻者相互抑制,比远邻更远的神经元则表现弱激励作用。由于这种交互作用的曲线类似于墨西哥人带的帽子,因此也称这种交互方式为“墨西哥帽”[2],如图2 所示:

SOM网络根据其学习规则,对输入模式进行自动分类,捕捉住各个输入模式中所含的模式特征,并对其进行自组织,在竞争层将分类结果表现出来,SOM网络的特点是:

1) 一旦由于某种原因,某个神经元受到损害或者完全失效,剩下的神经元仍可以保证所对应的记忆信息不会消失。

2) 网络对学习模式的记忆不是一次性完成的,而是通过反复学习,将输入模式的统计特征“溶解”到各个连接权上的。所以这种网络具有较强的抗干扰能力。

它的具体的工作原理过程如下:

1) 首先将权值赋予随机初始值;同时设置一个初始邻域,并设置网络的循环次数 ;

2) 然后给出一个新的输入模式输入到网络上;

3) 采用胜者为王的模式,计算模式和所有的输出神经元的距离,并选择和距离最小的神经元C, 即,则C即为获胜神经元;

4) 更新结点及其邻域结点的连接权值:

式中:为增益函数,随着时间逐渐减小;

5) 选取另一个学习模式提供给网络,返回步骤3),直到全部的输入模式都提供给网络;

6) 令, 返回步骤2), 直至为止。

由SOM网络的工作原理可以看出,标准SOM网络学习速率在递减过程中采用线性递减的方式,这将导致网络收敛速度慢,在数据量比较大的情况下就会导致网络聚类结果不稳定甚至发散。因此可以将改进学习率递减方式作为改进SOM网络的一个方向。

2.1 神经网络的改进

实验证明利用标准的自组织特征映射神经网络对分类的效果不是很理想,因为该算法对学习速率调整只采用线性递减,聚类的收敛速度慢,而且对邻域也只采用正方形或圆形域,造成权值调整时,邻域内所有神经元都同样激活,所以最终聚类效果不好,因此要想办法从改进学习率、邻域等方面来提高网络的性能。

将网络的学习过程分为2个阶段,分别为快学习阶段和调整阶段,在快学习阶段中,学

习速率采用幂函数递减的方式,聚类的效果较好,同时收敛的速度快,所采用的递减方式为

时收敛的速度快,所采用的递减方式为:

式中:为常数,一般为0.05

同时根据网络学习时神经元间相互作用曲线,侧反馈的强度与邻域内神经元i同获胜神经元C的距离有关, 典型的Gauss函数[3]最适合作为邻域函数,如式(3)所示:

式中:为邻域的有效宽度,而为竞争层神经元间的距离,对维元素其距离公式如下:

式中:分别表示神经元间在阵列上的坐标,并且采用幂函数递减

式中:参数一般取0.5

这样在快学习阶段学习率应递减较快,可采用幂函数形式,邻域从较大值递减为较小值,在调整阶段,网络学习集中对较小范围内的神经元的连接权值进行调整,其学习率递减缓慢,可采用线性函数形式,邻域值从较大值缓慢减小为0,即只包含获胜神经元。[page]

2.2 初始权值的确定

神经网络的初始权值对训练的效果有很大影响,一般来说初始权值的选择有三种方法[4]:

1) 将所有连接权向量赋予相同的初值,这样可以减少输入模式在最初阶段对权值的挑选余地,尽可能快地校正连接权向量与输入模式之间的方向偏差。

2) 当把连接权赋予[0,1]区间内随机初值之后,在网络学习的初级阶段对提供给网络的学习模式作一些修正。给原学习模式的每个元素加上一个很小的随机值,形成输入向量。由于比较容易找到与其方向大致一致的连接权向量,所以可以加快网络最初阶段的学习速度。随着学习的进行,逐渐滤掉中的随机值,使复原为,而这时与的方向已基本趋向一致,可以进入较精细的调整阶段。

3) 给每一个竞争层神经元增设输出阈值Q,以d+Q作为判断两向量距离的依据。在学习过程中,监视每个神经元被选中的次数。当发现某个神经元经常被选中时,暂时提高该神经元的阈值,进而增加其他神经元被选中的机会,提高连接权向量的利用率,以此来促进学习的快速进行。

当然也可以直接使用随机的初始权值,但是如果初始权值与最终所需结果偏差较大就有可能需要更多的训练才能得到需要的结果,甚至无法收敛,这就需要确定大致的权值的方法。

对于SOM神经网络来说,对输入数据进行简单处理就可以初步获得合适的权值,不仅可以使训练更顺利的进行,还可以避免所建立神经网络出现震荡。参考K-mean 法可以初步确定权值,具体过程如下:

1) 确定聚类数N,随机取N个数据为初始聚类中心

2) 根据输入与聚类中心距离,将输入划分为N类

3) 计算每一类分类的平均值作为新的聚类中心

4) 计算与距离,若为所求聚类中心,其中

此方法可初步确定权值,使训练更有效并且可以避免网络出现震荡或者无发收敛的情况。

3 仿真实验

实验数据为示功图图像[5]的三个特征参数如图3, 既 , 其中为段的弧度,为点与点的垂直距离,普通的SOM[2]神经网络的输入层节点数也等于输入矢量的维数,在本例中就是3,竞争层即输出层采取1*7的一维结构,训练次数为200次,改进的SOM在快学习阶段训练次数为80次,临域的初始半径为,学习率为。3,调整阶段训练次数为120次,临域初始半径为,学习率为。根据分析需要可以定义分类精度[6]

式中:参数为数据总数,为正确分类数,为精度。

式中:参数为数据总数,为正确分类数,为精度。

应用matlab建立所需的自组织特征映射神经网络[7] [8],并带入1400组数据(每种分类200组),对改进前和改进后的神经网络分别进行训练,分类结果的精度如上表1。

由示功图7个分类的聚类精度的对比可以看出,改进后的SOM的分类精度比改进前有了很大提高,提高幅度为21。4%,说明了对SOM神经网络学习速率以及收敛临域的改进可以有效的提高神经网络的聚类精度。

参考文献:

[1] HAMMERB,MICHELIA,SPERDUTIA.Recursive self-organizing network models [J].Neural Network,2004,17(8/9):1061-1085.

[2] 杨占华,杨燕.SOFM神经网络算法的研究与进展[J].计算机工程,2006,32(16):201-202,208.

[3] 王国学.高斯函数的性质及应用例析[J].高中数学教与学,2011,(7):9-11.

[4] 肖伟.初始化权值优化技术在机器人学习中的应用[J].电子学报,2005,33(9):1720-1722.

[5] 韩国庆,吴晓东,张庆生等.示功图识别技术在有杆泵工况诊断中的应用[J].石油钻采工艺,2003,25(5):70274.

[6] 张惟皎,刘春煌,李芳玉.聚类质量的评价方法[J].计算机工程,2005,31(20):10-12.

[7] 楼顺天,胡昌华等.基于MATLAB的系统分析与设计[M].西安:西安电子科技大学出版社,2001.9.

[8] 涂晓芝,颜学峰,钱峰。基于SOM网络的基因表达数据聚类分析[J].华东理工大学学报, 2006,32(8):992-996.

『本文转载自网络,版权归原作者所有,如有侵权请联系删除』

热门文章

更多

热门文章

更多